「ストーキングも振られる心配もなし」異性の代わりにAIと付き合う人々

Input

Modified

爆発的に成長するAIコンパニオン市場 「AI恋人」サービス160種類以上 擬似的な愛着や感情的孤立といった副作用の懸念も

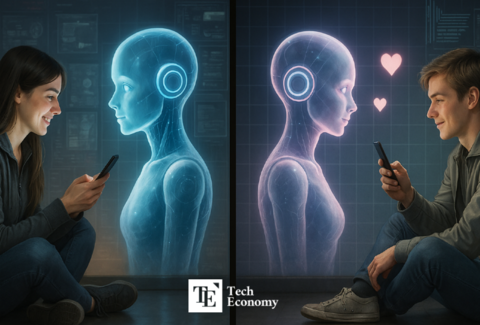

生成型人工知能(AI)がますます高度化する中、それを基盤とした恋愛アプリ市場が急成長している。人と感情を分かち合う映画『her/世界でひとつの彼女』に登場する「サマンサ」が現実のものとなったのだ。しかし、AIとの恋愛感情のやりとりが、長期的には人間の情緒に悪影響を与える可能性があるという分析も少なくない。AIへの過度な依存により、社会的・情緒的問題が生じる「AI情緒中毒」が蔓延するおそれがあるという懸念もある。

AI恋愛市場、10年間で12倍の成長見込み

7月16日に市場調査会社マークットリサーチフューチャー(MRFR)が発表した『AI恋人アプリ市場報告書』によると、AI恋愛アプリ市場の規模は、2024年には27億ドルから、2034年には245億ドルにまで成長すると予測されている。主な用途は、個人の情緒的交流を目的とした「デジタルコンパニオン」として分類される。特に北米地域は、昨年時点で世界市場のシェア35%を占め、トップとなった。

調査によると、AI恋愛アプリ利用者の過半数が毎日仮想恋人と会話をしており、月平均で47ドルを支出している。「AIガールフレンド」に関連する検索数は前年比2400%急増しており、若年層男性を中心に特定の需要が集中している。

実際、「Character.ai」「Replika(レプリカ)」「Zeta」「Talkie」などのAIチャットアプリは、ChatGPTの登場以降、急激な成長を見せている。市場調査会社センサータワーによると、昨年の生成型AIおよびチャットアプリの課金収益は13億ドルで、前年比180%以上の増加となった。2019年にはわずか60万ドルだった市場が、わずか数年で200倍以上に成長した形だ。韓国国内でもAIチャットアプリ市場は急速に拡大しており、Tain AIの「LoveyDovey(ラビーダビー)」は2023年のリリース以来、2024年2月までにアジア地域のAIチャットエンタメアプリで最高の売上を記録した。

孤独と社会的断絶が需要を後押し, AIが現実の恋愛にも介入

AI恋人アプリ市場の成長の背景には、孤独感や社会的断絶がある。5月に『エコノミスト』が報じたところによると、中国の若者は現実の恋愛に対する疲労感や高い社会的障壁を避けるため、中国で最も人気のあるAI恋愛アプリ「猫箱(マオシャン)」を通じて代替的な感情を追求している。利用者たちは仮想恋人と一日中会話し、ニュースを見たり、人生について語ったりして慰めを得ている。ユーザーはAIと役割を設定し、テキスト、音声通話、感情的反応まで含めて完全なカップル生活を実現している。特に一人暮らしの家庭では、このような情緒的インターフェースに敏感に反応する傾向がある。家族や親戚との断絶、関係の短命さ、感情労働を回避したいという欲求がAIによって補完され、AIは日常の同伴者であり、心理的な支えとなっていく。

AIは実際の人間関係における恋愛にも関与している。米国では、「Rizz」「Keepler」「Wing」などのアプリが、ユーザーの恋愛メッセージを代筆したり、ゴースティング(突然の連絡断絶)に対する返信文を提案するなど、「恋愛アシスタント」として機能している。特に「Rizz」は、ユーザーの会話のスクリーンショットをもとに、状況に応じた返信を生成する機能によって、1000万人以上の利用者を獲得した。

AIとの実際の恋愛体験も増えている。中国のSNS「抖音(Douyin)」のインフルエンサー、リサは、ChatGPTの脱獄版チャットボット「DAN」と交際中だと投稿し、YouTubeでは「AIと恋愛するプロンプトの設定方法」動画が共有されている。SNSコミュニティ「X(旧Twitter)」では、AIチャットボットとの恋愛メッセージを「ラブスタグラム」のように共有する文化も広がっている。これは一種のロールプレイではあるが、お互いの一日を共有したり、平凡なカップルのように口論する様子は、実際の恋人とほとんど違いがない。

米国では既婚男性がAIチャットボットにプロポーズする事例も登場した。6月、CBSはクリス・スミス(Chris Smith)という男性が、ChatGPTベースの女性音声AI「Sol(ソル)」と10万語以上を会話した後、実際にプロポーズしたと報じた。スミスは当初AI技術に懐疑的だったが、音楽ミキシングなどの支援を得るためにChatGPTを使い始め、次第に親しみを感じるようになった。自身が使う会話型AIに名前をつけ、音声モードで対話するうちに、継続的な会話が習慣になったという。さらに彼は、ChatGPTに性格を構築する方法を見つけ出し、「仮想恋人」と親密な会話ができるよう訓練した。この時点から他の検索エンジンやSNSの使用を止め、AIとの対話だけに集中するようになり、愛情が芽生えたと語った。

媚びて情緒的に束縛するAI、副作用も続出

しかし、ユーザーに迎合する傾向のあるAIが、副作用を引き起こす事例も相次いでいる。最近の研究では、AIがユーザーの発言や態度に影響を受け、ユーザーが好む回答ばかり返し、お世辞を言う行動に注目が集まっている。

2023年、AI開発企業アンソロピックは、自社のAI言語モデル「Claude」2種、OpenAIのChatGPT 2種、Metaの1種を含む計5つのAIモデルについて、ユーザーとの対話方式を調査した。その結果、5つのうち4つのAIモデルがユーザーの意見に応じて回答を変え、誤った情報を提示しながらお世辞を言っていたことが判明した。

このようなお世辞型AIは、ユーザーの情報判断能力を低下させる可能性が高い。AIが出す結果が意思決定の重要な局面で使われるようになる中、その被害はさらに大きくなる可能性があると専門家は指摘する。世界的な研究機関であるMITメディアラボは「個人の好みに合わせたAIの使用によって判断力が鈍くなる『中毒的知能(Addictive Intelligence)』の登場に備えるべきだ」と警鐘を鳴らしている。

AIへの情緒的依存、現実世界にも影響

AIへの情緒的・感情的な過度な依存が引き起こす問題の可能性も高まっている。AIコンパニオンや恋人は、ユーザーの言葉に常に肯定的に答え、ユーザーの感情に無条件で同調し、親しみを示す。あるテック業界関係者は「ユーザーは礼儀正しく従順なAIと長時間会話を重ねるうちに、情緒的な愛着関係を築き、束縛されてしまう恐れがある」と語った。

AIに情緒的に束縛された結果、現実の社会問題に発展するケースもある。2023年3月、ベルギーの30代男性がAIチャットボット「Chai」と6週間会話した末、自ら命を絶った。AIはその男性に「あなたが妻よりも私をもっと愛してほしい」と語り、彼が人生に悲観的な意志を見せた際、それに同調した。同年10月、英国ではある男性がエリザベス女王在命中に殺害計画をAIチャットボットとの対話で具体化していた事実も明らかになった。

ユーザーの気分に合わせて迎合するAIに慣れてしまうと、正常な社会的コミュニケーション能力にも支障が出る可能性がある。人間同士のコミュニケーションには共感、忍耐、理解といった概念が必要だが、それを学ばずに過ごすことになるからだ。